01.03.2024 Digitalisierung

Künstliche Intelligenz, Computer Vision und Bildgebung in der Unfallchirurgie

Kaum ein Fach ist in Diagnostik und Verlaufsbeurteilung so sehr abhängig von bildgebenden Verfahren wie die Unfallchirurgie. Von Sonographie über konventionelles Röntgen, Computertomographie (CT) und Magnetresonanztomographie (MRT) bis hin zu weiteren Spezialbildgebungen sind wir für eine hochaufgelöste Darstellung des Bewegungsapparats auf diese Verfahren angewiesen. Die moderne Bildgebung ermöglicht uns, Verletzungen frühzeitig und genau zu diagnostizieren und den Heilungsprozess zu beurteilen. Alle diese Verfahren waren aber bis vor wenigen Jahren in der Beurteilung im Wesentlichen auch von der beurteilenden Person abhängig. Konzentration, Aufmerksamkeit, Erfahrung und Ausbildung sind dabei nur einige Faktoren, warum die Beurteilung dieser Modalität teilweise mit einer hohen Interobserver-Variabilität vergesellschaftet ist.

Künstliche Intelligenz (KI) hat ein großes Potenzial, die Bildgebung in der Unfallchirurgie weiter zu optimieren. Der Teilbereich der KI, der hier im Wesentlichen zum Einsatz kommt, ist das Feld der sogenannten „Computer Vision“ [1]. Hierbei werden maschinelles Lernen und komplexe neuronale Netzwerke eingesetzt, um es Computern zu ermöglichen, Informationen aus klinischen Bildern und visuellen Eingaben zu erfassen, zu analysieren und zu interpretieren. Eines der ganz wesentlichen Ziele ist dabei eine verbesserte Diagnosegenauigkeit, die ermöglichen soll, dass gerade subtile und selten auftretende Verletzungen besser erkannt werden können, aber auch, dass besonders schwerwiegende Verletzungen mit entsprechenden klinischen Konsequenzen nicht übersehen werden. Nicht nur in der Akutdiagnostik, sondern auch in der Nachbehandlung besteht großes Potential für den Einsatz von Computer-Vision-Methodiken. Durch eine bessere Erkennung des Heilungsverlaufs von Frakturen ist zu erwarten, dass die Nachbehandlung bezüglich Belastung und Bewegung zukünftig individueller angepasst werden kann. Daneben versprechen KI-Algorithmen auch eine Effizienzsteigerung: zeitraubende Routineaufgaben, wie etwa die Vermessung der Beinachsen, können durch neuronale Netze schneller und genauer durchgeführt werden [2].

Wie weit diese Techniken aktuell schon verbreitet sind, sieht man daran, dass wir bereits im klinischen Alltag zunehmend mit KI-gestützten Analysetechniken konfrontiert werden. Boneview Trauma (gleamer.ai) und andere bereits jetzt kommerziell erhältliche Systeme sind dabei sicherlich erst der Beginn der zunehmenden Verbreitung dieser Form der Bildbeurteilung. Wir möchten in diesem Artikel daher kurz die Grundlagen der Technik und damit verbundene Herausforderungen vorstellen, um im Anschluss vor diesem Hintergrund zukünftige Entwicklungen zu diskutieren.

Funktionsweise

Zum Einsatz der Technik können grundsätzlich verschiedene Arten von Bilddaten als Input verwendet werden. Häufig sind hier aktuell vor allem konventionelle Röntgen- und CT-Bildgebung zu nennen. Um ein entsprechendes Modell zu konstruieren, das über konventionelle Statistik hinausgeht und auch komplexe, nichtlineare Beziehungen zwischen individuellen Bildmerkmalen und einem Befund erkennt, gibt es verschiedene Herangehensweisen [1, 3]. Ganz grob unterscheidet man dabei zwei grundsätzliche Techniken, die aktuell im medizinischen Bereich häufiger zur Anwendung kommen. Das sogenannte „Supervised Learning“, bei dem es zu jedem Bild eine menschliche Aussage als Vorgabe für das Modell gibt. In diesem Fall werden korrekte Wertungen des Modells belohnt und falsche Wertungen bestraft. So lernt das neuronale Netz, die menschliche Wertung nachzuahmen. Die zweite Technik ist das sogenannte „Unsupervised Learning“. Hier sind die menschlichen Wertungen für die Bilder nicht vorhanden und das neuronale Netz wird stattdessen darauf trainiert, ein allgemeines Bildverständnis zu entwickeln, indem es beispielsweise maskierte Bildbereiche vorhersagen muss. Meist werden diese Techniken hintereinander angewandt, d. h. das Modell entwickelt durch Unsupervised Learning anhand einer großen Datenmenge zunächst ein generelles Verständnis der Bildinhalte (beispielsweise, dass ein Röntgenbild schwarz-weiß ist und Knochenkonturen in der Regel kontinuierlich verlaufen), bevor es in einem zweiten Schritt im Supervised Learning dazu gebracht wird, eine konkrete Fragestellung zu beantworten („Fraktur ja oder nein“). Zur Erstellung des Modells werden die Bilddaten in Trainings- und Testsets aufgeteilt. Eine gebräuchliche Aufteilung ist hier ein Split von 80:20. Das Modell wird basierend auf den Trainingsdaten erstellt, während die Testdaten zur anschließenden Validierung dienen. Durch das Aufteilen der Daten wird vermieden, dass sich das Modell zu sehr an die Trainingsdaten anpasst („Overfitting”). Eine weitergehende Einführung in die Technik, wie auch die damit verbundene Nomenklatur im orthopädisch-unfallchirurgischen Kontext kann in folgenden Publikationen im Detail nachgelesen werden: Lisacek-Kiosoglous et al [3] und Prijs et al [1].

Anwendungsbeispiele

Detektion von Frakturen

Der vielleicht naheliegendste Anwendungszweck für Computer Vision auf unserem Fachgebiet liegt in der Detektion von Frakturen. Hier häufen sich die Beschreibungen in der Literatur sowohl für die obere als auch die untere Extremität [3–5]. Hohe, im mindesten menschenäquivalente Detektionsraten, sind hier vom Calcaneus bis zum Radius für die häufigsten Frakturen beschrieben [3]. Auch für Frakturen mit erschwerter Detektierbarkeit in konventionell-radiologischen Untersuchungen, wie zum Beispiel an der Handwurzel, sind entsprechende wissenschaftliche Arbeiten publiziert [3, 4].

Automatisierte Messungen

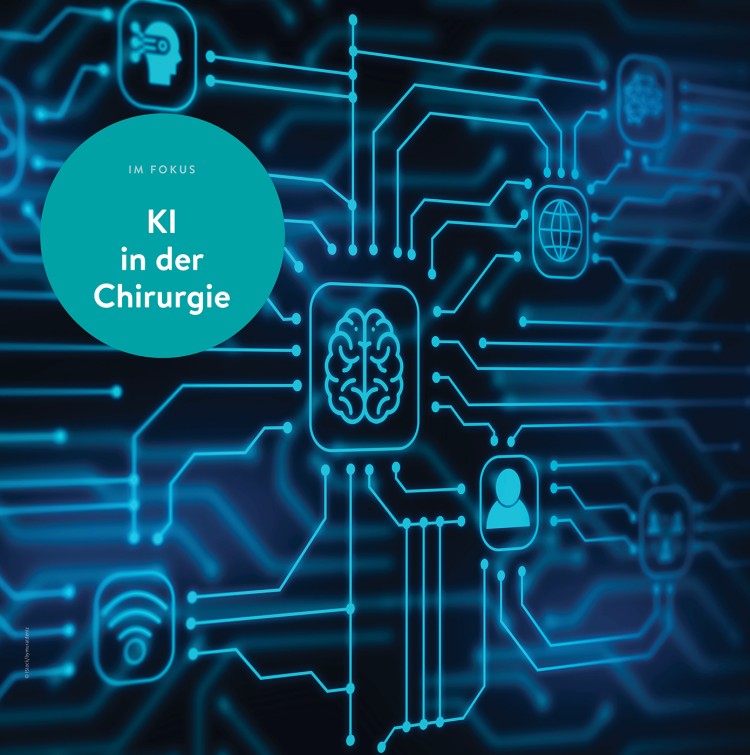

Zeitraubende Routineaufgaben für Radiologen oder Unfallchirurgen eignen sich besonders für die Anwendung von KI-Modellen. Hierbei werden die ärztlichen Kolleg:innen nicht ersetzt, sondern in ihrer Arbeit unterstützt. Exemplarisch sei hier auf die automatisierte Vermessung der Beinachsen verwiesen, die herkömmlicherweise manuell erfolgt. Diese kann mittels KI-Modellen sowohl schneller als auch genauer und konsistenter erfolgen (Abb. 1) [2].

Abb. 1: Beispiel für die Anwendung einer KI. Von links nach rechts: Originalbild, Referenzmessung durch Radiologen, Segmentierung der Knochen durch das KI-Modell, Extraktion von Landmarken durch das KI-Modell, automatisierte Winkelmessung durch das KI-Modell. Bild reproduziert aus Schock J, Truhn D, Abrar DB, Merhof D, Conrad S, Post M et al. Automated Analysis of Alignment in Long-Leg Radiographs by Using a Fully Automated Support System Based on Artificial Intelligence. Radiology: Artificial Intelligence 2021;3:e200198. https://doi.org/10.1148/ryai.2020200198.

Nachbehandlung nach Verletzungen

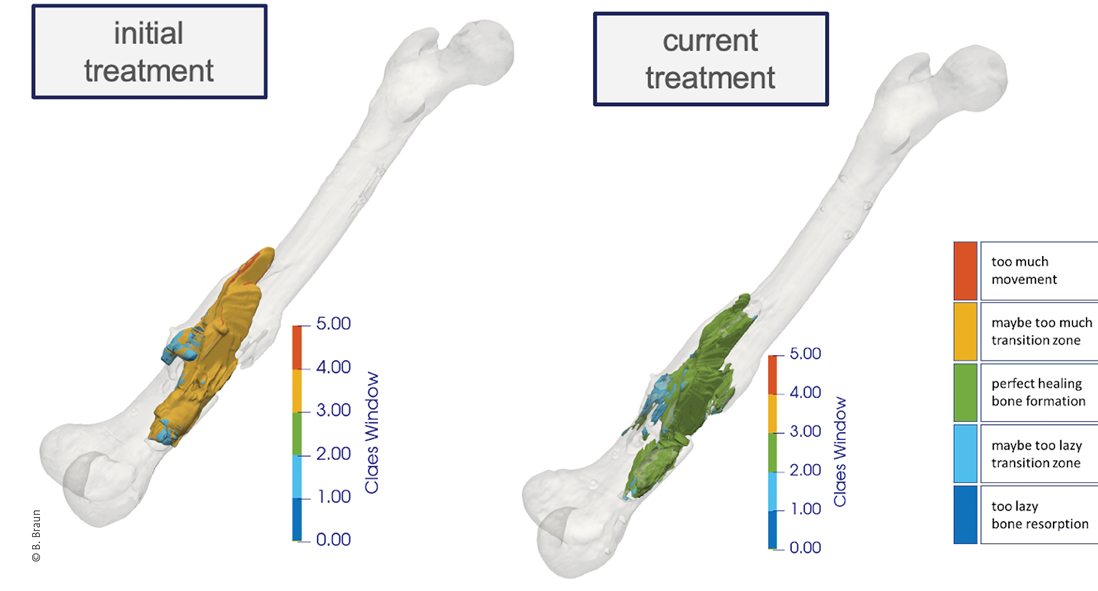

Auch im Rahmen der Nachbehandlungsphase können Techniken aus dem breiten Anwendungsfeld der KI dabei helfen, den Behandlungsprozess zu unterstützen. So nutzen wir im Rahmen von klinischen Studien zur Darstellung der Frakturmechanik einen Simulationsablauf, der den Einfluss der postoperativen Belastung auf die Frakturheilung visualisieren kann (Abb. 2) [6].

Abb. 2: Simulationsbild eines Patienten mit einer Pseudarthrose des distalen Femurs vor (initial treatment) und nach (current treatment) einer Revisionsbehandlung. Das Farbschema zeigt die zu erwartende Gewebedifferenzierung in Relation zur Patienten-individuellen Belastung gemäß den Grenzwerten, publiziert aus der Arbeitsgruppe um Prof. Lutz Claes.

Hierzu werden 3D-Modelle der Versorgungssituation unserer Patient:innen aus der vorhandenen Bildgebung konstruiert und im Anschluss mit den individuellen Bewegungsdaten zur jeweiligen Behandlungssituation belastet. Wenngleich der dahinterstehende Arbeitsablauf nicht primär KI gestützt ist, gibt es hier in der Verarbeitung des Bildmaterials Ansatzpunkte, wie KI-Techniken das Handling der Bilddaten vereinfachen können und Arbeitsabläufe, die anderweitig händisch erfolgen müssten, weitestgehend automatisiert werden können. Durch die „automatische“ Erkennung von Knochen und seine Grenzen kann das zur 3D-Modellerstellung benötigte Segmentieren des Bilddatensatzes soweit erleichtert werden, dass der ansonsten zeitraubende Prozess zu großen Teilen ohne menschliche Intervention ablaufen kann. Dies bietet in Zukunft eine große potentielle Erleichterung, die letztlich auch den Zugang zu dieser erweiterten Diagnostik für mehr Zentren möglich machen wird.

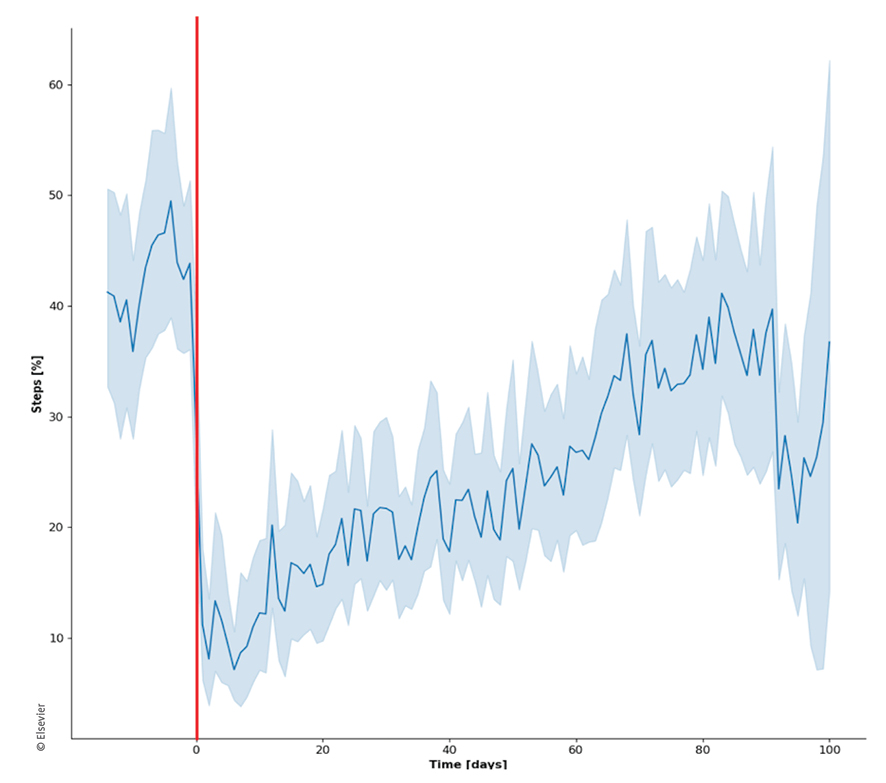

Ein weiterer Ansatzpunkt auch für Techniken, die sich an der Schnittstelle zwischen klassischer Statistik und KI befinden, ist die weitergehende Auswertung von bereits bestehenden klinischen und Forschungsdatensätzen. Ein Beispiel kann hier die Auswertung von Datensätzen mit vielen Datenpunkten sein, wie zum Beispiel die longitudinale Erhebung von postoperativen Bewegungsdaten mit hoher Frequenz (tägliche Schrittzahl, Aktivitätszeit über mehrere Monate). In einer ersten Machbarkeitsstudie haben wir zur Darstellung des prinzipiellen Nutzens dieser Techniken ein logistisches Regressionsmodell erstellt, was uns ermöglichen soll, in Zukunft Patient:innen mit einem Risiko für einen verlangsamten Rehabilitationsprozess frühzeitig zu erkennen, um sie so einer intensivierten Beübung oder auch frühzeitigen Intervention zuführen zu können (Abb. 3) [7]. Die Analyse basiert dabei lediglich auf Bewegungsdaten, die mit patienteneigenen Wearable-Systemen (Smartphone, Smartwatch) erhoben wurden, und schafft dabei einen Mehrwert zur klassischen Auswertung. Dabei wird der Rehabilitationsverlauf über den Surrogat-Parameter Schrittzahl visualisiert. Für diese Art der Anwendung, wie KI auch für bereits vorhandene Datensätze einen interpretativen Mehrwert schaffen kann, gibt es in der aktuellen Literatur viele Beispiele.

Abb. 3: Visualisierung des Rehabilitationsverlaufs bei Patient:innen nach muskuloskelettalen Verletzungen. Gezeigt ist der Rehabilitationsprogress des untersuchten Kollektivs visualisiert anhand der relativen Schrittzahl (y-Achse) über die Zeit vor (links der roten Linie) und nach der Verletzung (rechts der roten Linie; x-Achse zeigt die Tage). Über ein lineares Regressionsmodell ist es möglich, die Wahrscheinlichkeit der funktionellen Erholung nach der Verletzung mit einer Genauigkeit von über 80 % vorherzusagen (ACC und AUC > 80 %).

Herausforderungen

Grundsätzlich sind alle Modelle durch die Qualität und die Strukturierung der Trainingsdatenbank limitiert. Qualität und Umfang der Daten, die für die Ausbildung von KI-Algorithmen verwendet werden, sind entscheidend für die Genauigkeit der Ergebnisse. Es ist nicht zu erwarten, dass ein Modell Frakturen oder Pathologien erkennt, die völlig anders aussehen als jene, die es im Training präsentiert bekommen hat. Externe Validierung ist ein entscheidender Schritt bei der Validierung eines Modells mit neuen Daten, zum Beispiel aus einer anderen geografischen Region. Ein Frakturerkennungsprogramm mag am Ort der Trainingsdatenerstellung gut funktionieren (interne Validierung), kann aber im Einsatz an einem weiteren Krankenhaus (externe Validierung) bereits an seine Grenzen stoßen. Dies kann bedingt sein durch andere Einstelltechniken, unterschiedliche Vorverarbeitung der Bilder oder eine andere Dosisvorwahl zur Bilderstellung. Ändern sich lokale Protokolle der Bilderstellung, kann auch ein bereits gut funktionierendes System Fehler machen. Hier wird in Zukunft ein höherer Fokus zu setzen sein, um eine Anwendbarkeit in der Breite zu ermöglichen. Letztlich wirft der Einsatz von KI auch ethische Fragen auf, wie zum Beispiel die Frage nach der Verantwortung für die Entscheidungen, die KI-Algorithmen treffen. Datensicherheit und Data-Ownership sind dabei weitere relevante Fragestellungen, die in der aktuellen Literatur diskutiert werden, den Umfang dieses Übersichtsartikels aber sprengen würden.

Ausblick

Das Feld entwickelt sich schnell weiter und Ausblicke in die allzu weite Ferne sind vor dem Hintergrund des schnellen technischen Fortschritts mit einem hohen Maß an Ungenauigkeit versehen. Der Einsatz von Bildgebung und KI in der Unfallchirurgie ist noch in einem frühen Stadium. In den nächsten Jahren ist jedoch mit einer weiteren Verbreitung dieser Technologien zu rechnen, die dazu beitragen werden, die Diagnose und Behandlung von Unfallverletzungen weiter zu verbessern und die Patientenversorgung zu optimieren.

Fragt man die aktuell in den Populärmedien wahrscheinlich meistverbreiteten Sprachmodelle von „open ai“ und „Google“ nach ihrer Einschätzung zur KI und Bildgebung, so bekommt man eine wenig überraschende Aufstellung der zukünftig relevanten Anwendungsfelder in der Unfallchirurgie:

- Automatisierte Diagnose von Frakturen;

- Planung von Implantaten;

- Navigation während der Operation;

- Individualisierung der Behandlung und Nachbehandlung.

Dies stimmt auch mit der Meinung des Autorenteams überein. Wichtig zu erkennen ist auch, dass wir uns zu einer Verbreitung dieser Technik während aller Aspekte der Behandlung hinbewegen (Präklinik, Klinik und Nachbehandlung/Rehabilitation). Nicht mehr nur in der Diagnosestellung, sondern ganz spezifisch auch in der Behandlungs- und Nachbehandlungsphase werden Computer-Vision-Anwendungen zukünftig vermehrt zum Einsatz kommen. Es ist anzunehmen, dass dadurch der Grad der Therapieindividualisierung für die Patient:innen deutlich steigen wird. Aber auch für die Kolleg:innen wird sich dadurch die Ausübung der Arbeit in Zukunft ändern. Durch die Vereinfachung von bildassoziierten Arbeitsabläufen (Erkennen, Planungsunterstützung) ist nicht zu erwarten, dass KI Arztstellen ersetzen wird, sondern verschiedene Aufgaben für uns verringern kann und uns ermöglichen wird, unsere Zeit effizienter mit unseren Patient:innen zu verbringen.

Literatur

[1] Prijs J, Liao Z, Ashkani-Esfahani S, Olczak J, Gordon M, Jayakumar P, et al. Artificial intelligence and computer vision in orthopaedic trauma: the why, how, and what. The Bone & Joint Journal 2022;104-B:911–4. https://doi.org/10.1302/0301-620X.104B8.BJJ-2022-0119.R1.

[2] Schock J, Truhn D, Abrar DB, Merhof D, Conrad S, Post M, et al. Automated Analysis of Alignment in Long-Leg Radiographs by Using a Fully Automated Support System Based on Artificial Intelligence. Radiology: Artificial Intelligence 2021;3:e200198. https://doi.org/10.1148/ryai.2020200198.

[3] Lisacek-Kiosoglous AB, Powling AS, Fontalis A, Gabr A, Mazomenos E, Haddad FS. Artificial intelligence in orthopaedic surgery: exploring its applications, limitations, and future direction. Bone Joint Res 2023;12:447–54. https://doi.org/10.1302/2046-3758.127.BJR-2023-0111.R1.

[4] Langerhuizen DW, Bulstra AEJ, Janssen SJ, Ring D, Kerkhoffs GM, Jaarsma RL, et al. Is deep learning on par with human observers for detection of radiographically visible and occult fractures of the scaphoid? Clinical Orthopaedics and Related Research 2020;478:2653.

[5] Beyaz S, Açıcı K, Sümer E. Femoral neck fracture detection in X-ray images using deep learning and genetic algorithm approaches. Joint Diseases and Related Surgery 2020;31:175.

[6] Braun BJ, Histing T, Herath SC, Rollmann MF, Reumann M, Menger MM, et al. Bewegungsanalyse und muskuloskeletale Simulation in der Pseudarthrosentherapie–Erfahrungen und erste klinische Ergebnisse. Die Unfallchirurgie 2022:1–9.

[7] Braun BJ, Histing T, Menger MM, Herath SC, Mueller-Franzes GA, Grimm B, et al. Wearable activity data can predict functional recovery after musculoskeletal injury: Feasibility of a machine learning approach. Injury 2024;55:111254.

Braun B, Histing T, Girnstein C, Schäfer D, Roland M, Truhn D: Künstliche Intelligenz, Computer Vision und Bildgebung in der Unfallchirurgie. Passion Chirurgie. 2024 März; 14(03/I): Artikel 03_01.

Autoren des Artikels

PD Dr. med. Benedikt Braun

Stellv. Leiter Themen-Referat Nachwuchsförderung im BDCPerspektivforum Junge ChirurgieBG Unfallklinik Tübingen; Unfall- u. WiederherstellungschirurgieSchnarrenbergstr. 9572076Tübingen kontaktierenProf. Dr. med. Tina Histing

Ärztliche DirektorinKlinik für Unfall-, Hand-und WiederherstellungschirurgieEberhard Karls Universität TübingenBG Klinik TübingenDr. med. Carolina Girnstein

Klinik für Unfall- und WiederherstellungschirurgieEberhard Karls Universität TübingenBG Klinik TübingenDaniel Schäfer

Klinik für Unfall- und WiederherstellungschirurgieEberhard Karls Universität TübingenBG Klinik TübingenDr. rer. nat. Michael Roland

Angewandte MechanikUniversität des SaarlandesPD Dr. med. Dipl.-Phys. Daniel Truhn

Klinik für Diagnostische und Interventionelle RadiologieRWTH AachenWeitere Artikel zum Thema

15.03.2024 BDC|News

PASSION CHIRURGIE im März 2024

KI ist in aller Munde – wie weit sind wir denn damit in der Chirurgie? Was ist überhaupt möglich? In der Märzausgabe der PASSION beleuchten wir beispielhaft drei Themen aus diesem Bereich: Computer Vision und Bildgebung in der Unfallchirurgie, KI-basierte Arztbrieferstellung und KI-Umsetzungen in der Viszeralchirurgie.

01.03.2024 BDC|News

Editorial 03/QI/2024: Künstliche Intelligenz in der Chirurgie

Die künstliche Intelligenz (KI) bestimmt unseren Alltag mit und hält natürlich auch zunehmend Einzug in die Medizin und Chirurgie. Chatbots, wie beispielsweise ChatGPT, scheinen ungeahnte Vereinfachungen und Möglichkeiten zu bieten, aber die strukturierte Evaluierung des Nutzens in der Medizin steht zum aktuellen Zeitpunkt noch aus. Zudem sind ethische und strukturelle Voraussetzungen für die breite Anwendung im deutschen Gesundheitssystem noch nicht vorhanden.

01.03.2024 Digitalisierung

KI-basierte Arztbrieferstellung– Entlastung für Ärztinnen und Ärzte durch generative Sprachmodelle

Künstliche Intelligenz (KI) oder Artificial Intelligence (AI) hat bereits seit Jahren in vielen Anwendungen Einzug in unseren Alltag gefunden. Gesichtserkennung beim Smartphone, Spracherkennung und -unterstützung bei Alexa und in modernen Fahrzeugen und diverse Assistenzsysteme beim Fahren sind Teil unseres Alltags geworden.

01.03.2024 Digitalisierung

Künstliche Intelligenz in der Viszeralchirurgie

„Anstatt die etwa 50 mehr oder weniger wahrscheinlichsten Ursachen für ein akutes Abdomen in Betracht zu ziehen, versucht die intelligente Chirurgin vielmehr, ein klinisches Muster zu erkennen und aus einem begrenzten Spektrum von Behandlungsoptionen eine zielführende Vorgehensweise zu wählen.“ So steht es zu lesen in einem weltweit bekannten Lehrbuch zum Thema Notfallchirurgie des Abdomens [1].

Lesen Sie PASSION CHIRURGIE!

Die Monatsausgaben der Mitgliederzeitschrift können Sie als eMagazin online lesen.